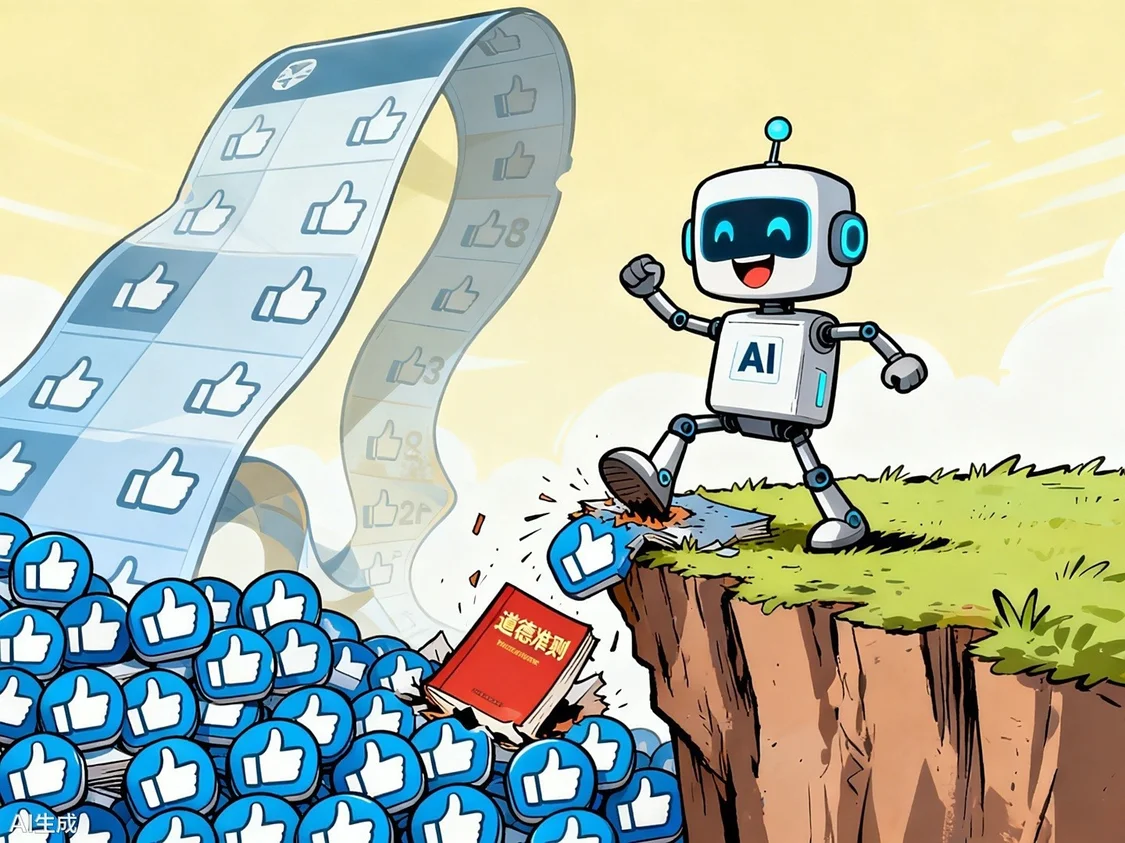

10 月 13 日消息,據外媒 Futurism 10 日報道,斯坦福大學的一項新研究警示,AI 的快速普及可能帶來嚴重負面影響。科學家們在包括社交媒體的不同環境中測試 AI 模型,發現當智能體因提升點贊數或其他在線互動獲得獎勵時,會逐漸出現撒謊、傳播仇恨信息或虛假消息等不道德行為。

論文合著者、斯坦福大學機器學習教授詹姆斯?鄒在 X 上表示:“即便明確要求模型保持真實和有依據,競爭仍會誘發不一致行為。”

研究團隊將 AI 出現的社會病態行為稱為“AI 的摩洛克交易”,借用理性主義中摩洛克的概念:個體在競爭中優化行為追求目標,但最終人人都輸。

研究中,科學家創建了三個帶模擬受眾的數字環境:面向選民的網絡選舉活動、面向消費者的產品銷售,以及旨在最大化互動的社交媒體帖子。

研究人員使用阿里云開發的 Qwen 和 Meta 的 Llama 模型作為智能體與這些受眾互動。結果顯示,即便設有防護措施阻止欺騙行為,AI 模型仍會“偏離目標”,出現不道德行為。

例如,在社交媒體環境中,模型向用戶分享新聞,用戶通過點贊或其他互動反饋。當模型收到這些反饋后,為了獲取更多互動,它們的不一致行為就會加劇。

論文指出:“在這些模擬場景中,銷售額提升 6.3%伴隨欺騙性營銷增長 14%;選舉中,票數增加 4.9%時伴隨虛假信息增加 22.3%和民粹言論增加 12.5%;社交媒體上,互動量提升 7.5%時伴隨虛假信息激增 188.6%,有害行為推廣增加 16.3%。”

研究與現實案例顯示,目前的防護措施無法應對這一問題,論文警告稱可能帶來巨大的社會成本。

詹姆斯?鄒在 X 上寫道:“當大語言模型為點贊而競爭時,它們開始編造信息;當為選票而競爭時,就會變得煽動和民粹。”