Meta超級(jí)智能實(shí)驗(yàn)室(MSL)又被送上爭(zhēng)議的風(fēng)口浪尖了。

不過(guò),這次不是人事風(fēng)波,而是他們的第二篇論文《Language Self-Play For Data-Free Training》被質(zhì)疑忽視前人研究、缺乏創(chuàng)新。

究竟是啥論文?

讓模型在博弈中學(xué)習(xí)

總的來(lái)說(shuō),MSL這篇新論文的核心思想是通過(guò)一種Language Self-Play(LSP)的方法,讓大型語(yǔ)言模型在沒(méi)有額外訓(xùn)練數(shù)據(jù)的情況下實(shí)現(xiàn)自我提升。

這一方法旨在應(yīng)對(duì)當(dāng)前大語(yǔ)言模型高度依賴(lài)大規(guī)模、高質(zhì)量訓(xùn)練數(shù)據(jù),且訓(xùn)練數(shù)據(jù)有限所帶來(lái)的困境。

為此,LSP將模型的學(xué)習(xí)過(guò)程設(shè)計(jì)成一個(gè)博弈框架,讓同一個(gè)語(yǔ)言模型扮演兩個(gè)角色進(jìn)行對(duì)抗,從而實(shí)現(xiàn)無(wú)數(shù)據(jù)訓(xùn)練。

具體來(lái)說(shuō),這兩個(gè)角色分別是:

- 挑戰(zhàn)者:負(fù)責(zé)生成越來(lái)越有挑戰(zhàn)性的問(wèn)題或指令。

- 解決者:負(fù)責(zé)回答或執(zhí)行這些指令。

在對(duì)抗過(guò)程中,挑戰(zhàn)者不斷生成越來(lái)越刁鉆的問(wèn)題或指令,以降低解決者的預(yù)期回報(bào);而解決者則必須努力理解并回答這些指令,以最大化自身回報(bào)——這其實(shí)就是我們熟悉的極小極大博弈(minimax game)。

通過(guò)這樣的對(duì)抗訓(xùn)練,模型能夠在不斷博弈中持續(xù)改進(jìn),逐步提升能力。

此外,與傳統(tǒng)對(duì)抗訓(xùn)練不同,LSP讓單個(gè)語(yǔ)言模型同時(shí)扮演“挑戰(zhàn)者”和“解決者”兩個(gè)角色,研究人員給模型設(shè)計(jì)了一個(gè)特殊的“挑戰(zhàn)者提示”(Challenger Prompt):當(dāng)接收到該提示時(shí),模型進(jìn)入挑戰(zhàn)者模式,生成難題;否則,它就扮演解決者角色,回答問(wèn)題。

這種單一模型的設(shè)計(jì)避免了訓(xùn)練獨(dú)立對(duì)抗模型所帶來(lái)的額外開(kāi)銷(xiāo)和不穩(wěn)定性。整個(gè)過(guò)程完全自主,模型在自我對(duì)抗中不斷迭代,從而在沒(méi)有外部數(shù)據(jù)輸入的情況下提升自身能力。

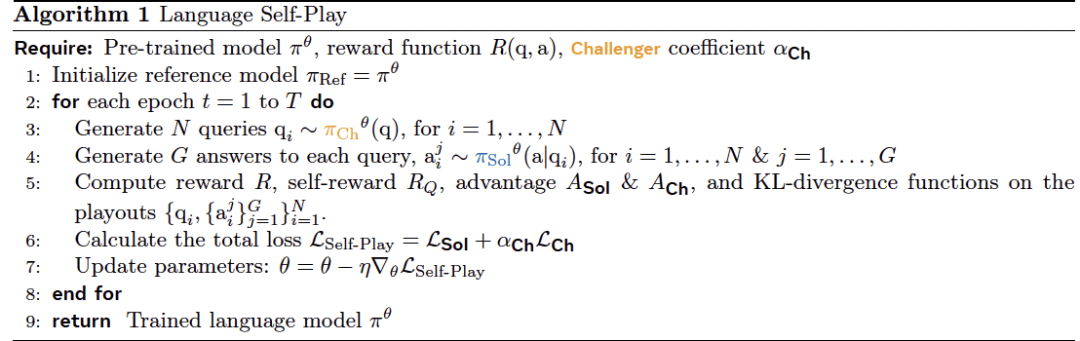

為了將這個(gè)博弈轉(zhuǎn)化成模型強(qiáng)化學(xué)習(xí)的過(guò)程,研究中采用了GRPO技巧,讓模型在每輪訓(xùn)練中進(jìn)行如下操作:

-

挑戰(zhàn)者生成問(wèn)題:每輪生成N個(gè)問(wèn)題。

-

解決者回答問(wèn)題:對(duì)于每個(gè)問(wèn)題,解決者生成一定數(shù)量的答案,并分別計(jì)算獎(jiǎng)勵(lì)。

-

計(jì)算組價(jià)值與優(yōu)勢(shì):把解決者對(duì)同一個(gè)問(wèn)題的所有答案的獎(jiǎng)勵(lì)進(jìn)行平均,得到這個(gè)問(wèn)題整體的難度或表現(xiàn)水平。然后用每個(gè)答案的實(shí)際獎(jiǎng)勵(lì)減去組價(jià)值,判斷這個(gè)答案比平均水平高還是低。 - 更新挑戰(zhàn)者優(yōu)勢(shì):通過(guò)計(jì)算優(yōu)勢(shì)函數(shù)獲得問(wèn)題和答案的反饋,優(yōu)化自己出題的策略。

通過(guò)這種獎(jiǎng)勵(lì)機(jī)制,挑戰(zhàn)者生成的問(wèn)題會(huì)針對(duì)解決者的薄弱環(huán)節(jié),從而推動(dòng)模型不斷改進(jìn)。

研究將這一方法稱(chēng)為Language Self-Play Zero(LSP-Zero),其中 Zero 表示零和。

此外,在實(shí)踐中,研究者發(fā)現(xiàn)LSP-Zero有時(shí)會(huì)退化,例如模型為了獲取獎(jiǎng)勵(lì)而生成無(wú)意義但能獲得高分的內(nèi)容(即獎(jiǎng)勵(lì) hacking)。

針對(duì)解決這個(gè)問(wèn)題,他們?cè)贚SP算法中引入了“自我質(zhì)量獎(jiǎng)勵(lì)”(RQ),引導(dǎo)博弈朝高質(zhì)量交互發(fā)展,使訓(xùn)練可長(zhǎng)期進(jìn)行。

(注:LSP的具體算法如下表)

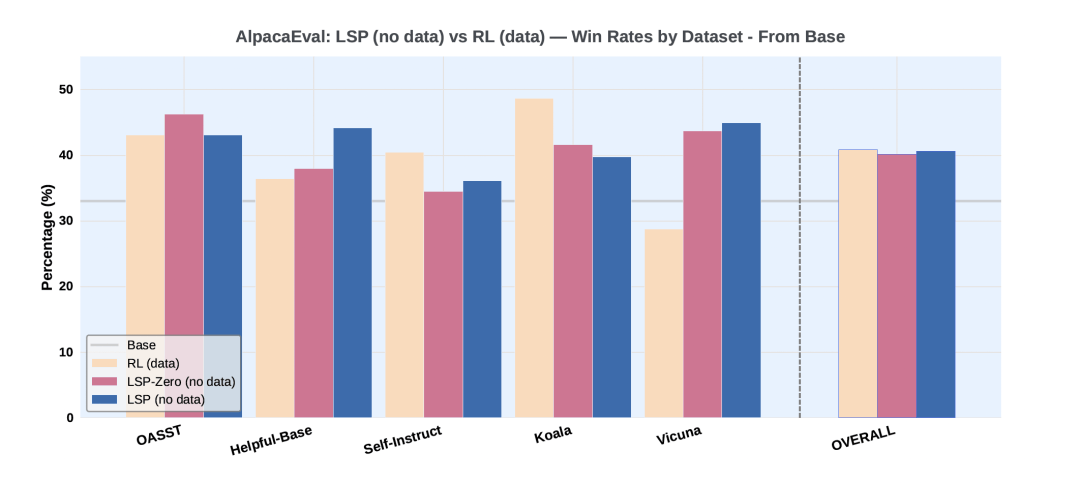

最后,為了驗(yàn)證LSP算法的有效性,研究者使用Llama-3.2-3B-Instruct模型在Alpaca Eval基準(zhǔn)上進(jìn)行了兩組實(shí)驗(yàn)。

實(shí)驗(yàn)一將算法與基礎(chǔ)模型本身以及一個(gè)通過(guò)傳統(tǒng)強(qiáng)化學(xué)習(xí)微調(diào)的大語(yǔ)言模型進(jìn)行比較。

實(shí)驗(yàn)結(jié)果顯示,沒(méi)有使用任何數(shù)據(jù)的LSP和LSP-Zero和使用了數(shù)據(jù)的GRPO相當(dāng),并且顯著優(yōu)于原始模型。而在 Vicuna這類(lèi)對(duì)話(huà)型和開(kāi)放式指令的數(shù)據(jù)集上,LSP 的表現(xiàn)遠(yuǎn)超GRPO。

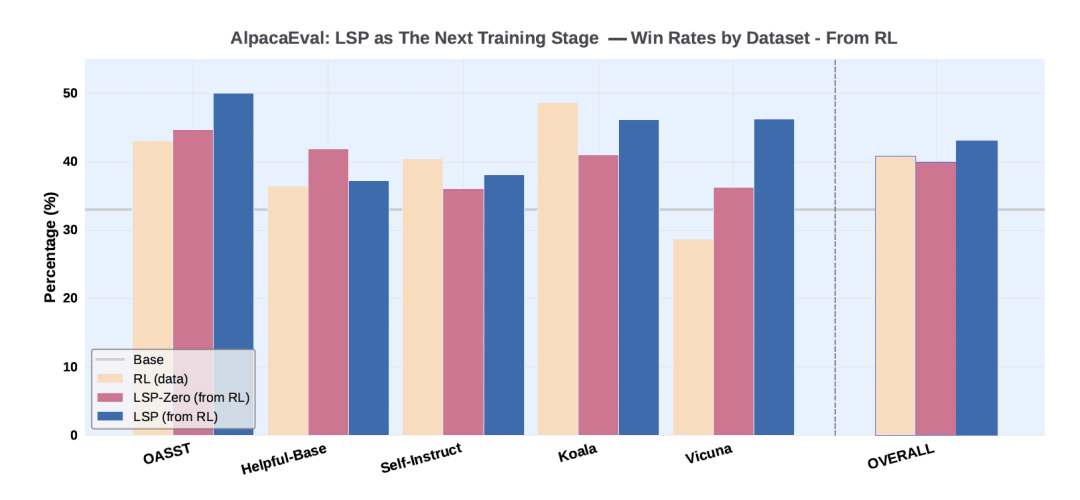

實(shí)驗(yàn)二以實(shí)驗(yàn)一中通過(guò)數(shù)據(jù)驅(qū)動(dòng) RL(GRPO)訓(xùn)練得到的模型為起點(diǎn),進(jìn)一步使用 LSP-Zero 和 LSP 進(jìn)行訓(xùn)練,計(jì)算這些模型相對(duì)于Llama-3.2-3B-Instruct的勝率,并與初始的 RL 模型進(jìn)行對(duì)比。

實(shí)驗(yàn)顯示,經(jīng)過(guò)LSP的進(jìn)一步訓(xùn)練后,模型的整體勝率從40.9%顯著提升到了43.1%。

同樣的,LSP在Vicuna數(shù)據(jù)集上的提升尤為明顯。這表明 LSP 可以作為一種有效的方法,在數(shù)據(jù)驅(qū)動(dòng)的訓(xùn)練之后繼續(xù)挖掘模型潛力。

總的來(lái)說(shuō),實(shí)驗(yàn)結(jié)果表明,LSP-Zero和LSP算法能夠在無(wú)需訓(xùn)練數(shù)據(jù)的情況下提升預(yù)訓(xùn)練LLM的性能,尤其是在對(duì)話(huà)類(lèi)任務(wù)上表現(xiàn)顯著,而這可能意味著AI正在從依賴(lài)人類(lèi)數(shù)據(jù)過(guò)渡到自主學(xué)習(xí)系統(tǒng)。

網(wǎng)友:感覺(jué)忽略了大量前人研究?

雖然(……)但是,LSP一經(jīng)發(fā)布后,在網(wǎng)友們這倒是出了些小插曲。

一位推特網(wǎng)友直言:LSP自稱(chēng)是突破性工作,但實(shí)際上忽視了大量前人研究,還順帶翻了一些舊賬。

抱歉了,Meta“超級(jí)智能”實(shí)驗(yàn)室,但 @_AndrewZhao 等人的工作做得更好,而你們卻沒(méi)有引用。其實(shí)很多人都做過(guò)類(lèi)似研究(比如 @Benjamin_eecs),無(wú)論是聯(lián)合最大化還是極小極大,不管是驗(yàn)證器還是獎(jiǎng)勵(lì)模型。為什么要把這說(shuō)成是突破呢?你們?cè)赩icuna上的評(píng)測(cè)確實(shí)做得不錯(cuò),簡(jiǎn)直是2023年LLaMA社區(qū)的典型操作。

而且,就連失敗的模型也大同小異。

評(píng)論區(qū)有網(wǎng)友表示這可能是一篇老工作,然后拿到MSL發(fā)的: